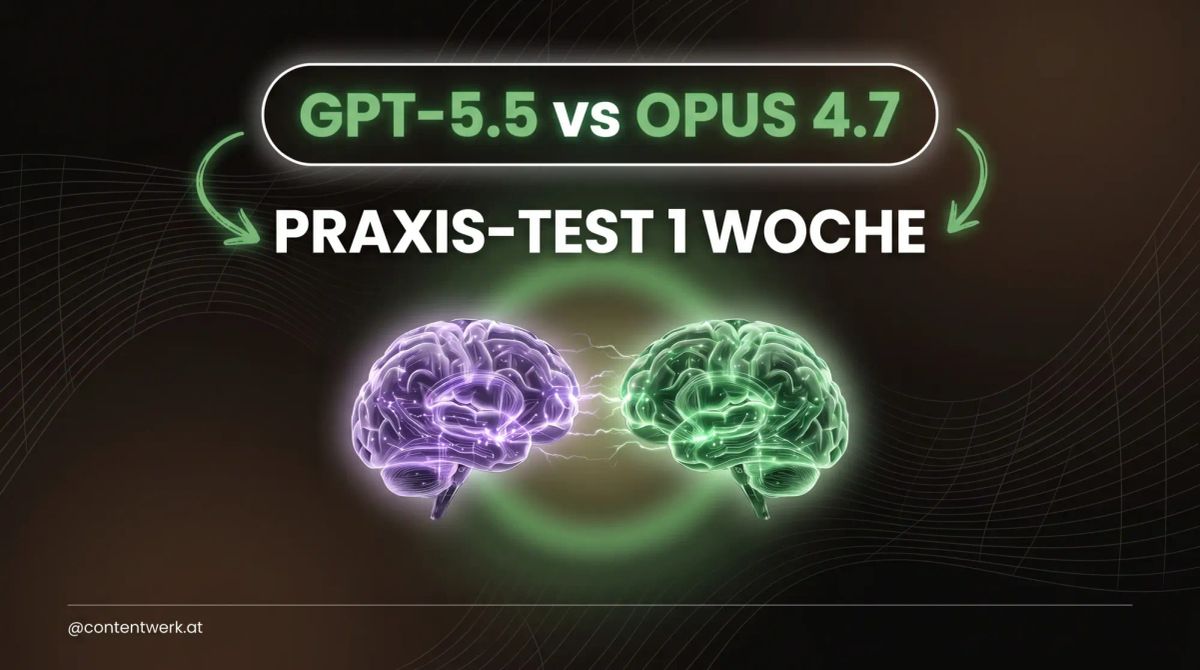

GPT-5.5 vs Claude Opus 4.7: Mein 1-Wochen-Praxis-Test

Claude Opus 4.7 gewinnt 12 von 14 Benchmarks gegen GPT-5.5 — bei gleichem Preis. Wann du welche KI nimmst, basierend auf einer Woche Praxis-Test.

OpenAI hat letzten Donnerstag GPT-5.5 gedroppt. 24 Stunden später hatten alle KI-Newsletter dieselbe Headline. "Game Changer." "Smarter als alles davor." "Killt Claude." Ich hab beide diese Woche durchgetestet — und das Bild ist anders.

Hier kommt der ehrliche Vergleich für jemanden, der mit KI Content produziert. Nicht Code schreibt. Nicht Forschungspapiere durchwühlt. Content. Reels, Skripts, Captions, Blog-Posts, E-Mails an Kunden. Das Tagesgeschäft.

Was GPT-5.5 wirklich kann

OpenAI hat ein Agent-Modell gebaut. Das ist die echte Neuigkeit. Nicht "smarter". Nicht "schneller". Sondern: du gibst GPT-5.5 jetzt eine messy Multi-Step-Aufgabe — und es plant, nutzt Tools, prüft sich selbst, navigiert durch Ambiguität und macht weiter. Bis fertig.

Klingt wie Marketing-Sprech. Ist es nicht.

Ich hab es getestet mit dieser Aufgabe: "Schau dir meine letzten 10 Reels-Captions an, finde die 3 mit dem höchsten Engagement, analysiere was die gemeinsam haben, und schreib mir 5 neue Hooks im selben Stil."

Acht Minuten später hatte ich eine Tabelle, eine Analyse und 5 Hooks. Hat selbst Browser-Tools genutzt um die Daten zu ziehen. Kein einziger Prompt-Refinement nötig.

Bei Claude Opus 4.7 musste ich für dieselbe Aufgabe vier Mal nachjustieren, Daten manuell einkippen, dann zusammenfassen lassen. Punkt für GPT-5.5.

Der Benchmark, den niemand zeigt

Bei reinem Output — Schreiben, Coding, Research, Analyse — gewinnt Claude Opus 4.7 zwölf von vierzehn Benchmarks gegen GPT-5.5. Bei gleichem Preis. 5 Dollar pro Million Input-Tokens, 25 Dollar Output. Identisch.

Das hat OpenAI nicht in der Keynote erwähnt. Logisch. Aber es ist die Wahrheit für jeden, der mit dem Output arbeitet — statt mit der Pipeline davor.

Beispiel aus dieser Woche: ich hab beide ein 90-Sekunden-Reels-Skript schreiben lassen. Selbe Anweisung, selber Ton, selbes Thema. Claude kam mit kürzeren Sätzen, schärferer Hook und einem CTA der gesessen hat. GPT-5.5 hat mir 20 Prozent mehr Wörter geliefert — die ich dann wieder gekürzt habe.

Das ist ein Pattern. Ich seh's seit zwei Jahren bei jedem Modell-Vergleich.

Mein 1-Wochen-Test

Ich hab eine Woche lang dokumentiert, wofür ich was nehme. Hier die Realität — ungeschnitten:

- Reels-Skripts und Captions: Claude. Jedes Mal.

- E-Mails an Kunden: Claude.

- "Geh online, finde das raus, fass zusammen": GPT-5.5. Jedes Mal.

- Code für meine Editing-Pipeline: Claude.

- Tabelle aus Chaos-Daten bauen: GPT-5.5.

- Long-Form Blog-Post in meiner Stimme: Claude — mit Abstand.

- Meeting-Vorbereitung mit Recherche aus zehn Quellen: GPT-5.5.

Das Pattern: GPT-5.5 ist der bessere Assistent für Tasks, die Schritte und Tools brauchen. Claude ist der bessere Schreiber, wenn du den Output ungeschnitten verwenden willst.

Beides hab ich nach 500 Millionen Views in den letzten zehn Jahren als Videograf gelernt: das beste Tool ist immer das, das dir am wenigsten Nacharbeit kostet. Nicht das, was die meisten Features hat.

Der Preis-Kipper

Hier wird es interessant. Beide Modelle kosten über die API gleich viel. Aber das Pricing für Selbstständige unterscheidet sich, sobald du einen Plan abonnierst.

ChatGPT Plus: 23 Dollar im Monat. GPT-5.5 inklusive, plus die Agent-Features.

Claude Pro: 18 Euro im Monat. Opus 4.7 mit höheren Limits als bei OpenAI.

Wenn du nur Schreibarbeit machst — nimm Claude. Fünf Euro im Monat gespart, besseres Output, dasselbe Modell-Lineup.

Wenn du KI für Recherche und Multi-Step-Tasks brauchst — ChatGPT. Die Agent-Features sind im Pro-Plan freigeschaltet, was bei Anthropic noch nicht drin ist.

Wenn du beides machst — ja, beides. Klingt nervig. Ist aber die Realität für Leute die Content produzieren UND eine Business-Pipeline laufen haben. Ich hab seit Februar beide Abos. Und ich werd sie behalten.

Was sonst noch im GPT-5.5-Drop steckt

Zwei Sachen die untergegangen sind:

Images 2.0 — ChatGPT hat ein neues Bildmodell auf alle Pläne ausgerollt. Qualität ist ordentlich. Für Cover-Bilder und Thumbnails brauchbar. Nicht auf Midjourney-Niveau, aber für Quick-and-Dirty völlig okay.

Fast Answers — ein neuer Antwort-Modus für simple Fragen. Liefert in zwei Sekunden statt zehn. Für "wie viele Stunden hat die Erde", nicht für strategische Recherche.

Beides nice. Beides nicht der Grund für ein Upgrade.

Wann ich was nehme — die simple Regel

Frag dich vor jedem Prompt eine einzige Frage: "Brauche ich am Ende Worte oder einen Workflow?"

Worte: Claude.

Workflow: GPT-5.5.

Das deckt 90 Prozent meiner Fälle ab. Die restlichen zehn — meistens Edge Cases wo ich beide parallel öffne und vergleiche. Dauert dreißig Sekunden, kostet keine fünf Cent.

Was du diese Woche entscheidest

Drei konkrete Schritte:

- Wenn du noch nichts hast: starte mit Claude Pro. 18 Euro, Schreibarbeit ist 80 Prozent von dem was Selbstständige mit KI machen.

- Wenn du schon ChatGPT Plus hast: teste GPT-5.5 mit einer Multi-Step-Aufgabe diese Woche. Eine, die du sonst eine Stunde gemacht hättest. Schau wie es läuft. Dann entscheide ob die 23 Dollar bleiben.

- Wenn du beides nutzen willst: nimm Claude für die kreative Arbeit, ChatGPT für die operative. Probier das eine Woche. Dann entscheide, was du behältst — oder ob beide bleiben.

Keine Religion. Nur Tools. Beide werden in sechs Monaten von einem neuen Modell überholt — und du nutzt dann das, was funktioniert.

Mehr darüber wie ich KI in den eigenen Content-Workflow einbaue, gibt's in der ContentWerk Community. Da posten Selbstständige täglich was bei ihnen wirkt, was nicht — und ich teil die Setups die ich seit zehn Jahren in der Videoproduktion verwende.

---